眾所周知,openstack的通信方式有兩種,一種是基于http協議的restful api方式,另一種則是rpc調用。兩種通信方式的應用場景有所不同,在openstack中,前者主要用于各組件之間的通信(如nova與glance的通信),而后者則用于同一組件中各個不同模塊之間的通信(如nova組件中nova-compute與nova-scheduler的通信)。

nova中rpc調用非常多,用pycharm點點點跟函數的時候遇到rpc就會點不下去了,不解決直接就看不下去了那種多法

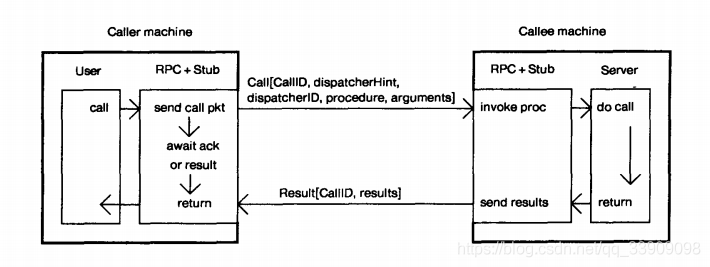

什么是 rpc

看不明白這個圖對于看nova代碼,其實不是很重要,直接忽略以后再看也可以,當務之急是解決一下看openstack代碼遇到rpc就跟丟了的問題

rpc、消息隊列、restful

這三個其實不是一個層面的東西,本質上不應該放在一起比,但是因為都用來通信,比較容易混淆就還是解釋一下

- restful:主要用于各組件之間的通信(比如nova與glance的通信),或者說用于組件對外提供調用接口

- rpc:則用于同一組件中各個不同模塊之間的通信(比如nova組件中nova-compute與-nova-scheduler的通信)

- 消息隊列:用于解耦組件,也是組件間通信用的,而且會有一個隊列用來暫存消息

在nova中的典型rpc

nova/nova/nova/conductor/tasks/live_migrate.py

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

|

class livemigrationtask(base.taskbase): def __init__(self, context, instance, destination, block_migration, disk_over_commit, migration, compute_rpcapi, servicegroup_api, scheduler_client): super(livemigrationtask, self).__init__(context, instance) ... def _execute(self): self._check_instance_is_active() self._check_host_is_up(self.source) if not self.destination: self.destination = self._find_destination() self.migration.dest_compute = self.destination self.migration.save() else: self._check_requested_destination() # todo(johngarbutt) need to move complexity out of compute manager # todo(johngarbutt) disk_over_commit? #調用 computeapi 類中的 live_migration() rpc接口 return self.compute_rpcapi.live_migration(self.context, host=self.source, instance=self.instance, dest=self.destination, block_migration=self.block_migration, migration=self.migration, migrate_data=self.migrate_data) |

conductor以compute_rpcapi.live_migration的方式遠程調用compute的live_migration,過程就是, conductor以rpc的方式發出一個請求到queue再被nova-compute接收

nova/nova/nova/compute/rpcapi.py

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

|

class computeapi(object): # 這是一個rpc遠程調用的方法 def live_migration(self, ctxt, instance, dest, block_migration, host, migration, migrate_data=none): args = {'migration': migration} version = '4.2' if not self.client.can_send_version(version): version = '4.0' # 獲取目標 compute 主機(dest host)的rpc client,即被調用的服務進程的hostip cctxt = self.client.prepare(server=host, version=version) # 通過目標主機對象的 rpc cliient 來調用遠程過程方法 cast() ,以此來實現遠程調用 cctxt.cast(ctxt, 'live_migration', instance=instance, dest=dest, block_migration=block_migration, migrate_data=migrate_data, **args) # cast()異步遠程調用,不會阻塞別的進程,適合于需要長時間進行的執行過程 # cast()的第二個參數是rpc client調用的函數名,case()后面的參數會繼續作為參數傳入該調用函數 # cast()函數內的live_migration()函數是 manager.live_migration() 視具體實現遷移功能的函數,在manager.py內實現。 |

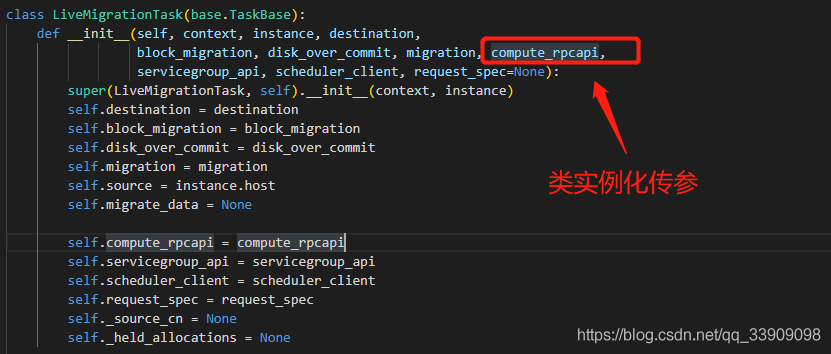

調用的時候是從nova/nova/conductor/tasks/live_migrate.py到nova/nova/compute/rpcapi.py,但是實際上是compute服務首先得在rpcapi.py提供出接口函數,然后使用者通過

- 1. import導入的方式去使用rpc調用

- 2. 類實例化傳參的方式去引入

熱遷移這里用的就是類實例化傳參

tip: call()表示同步調用 和 cast()表示異步調用

根據在rpc.py或者rpcapi.py中的cast()的第二個參數,去該服務下的manager.py中找和這個參數同名的函數(這個就是rpc最終想要調用的函數),我們這里是compute_rpcapi,所以要去找compute下的mannager.py

為什么要去找mannager,是因為nova.compute.manager 會一直監聽 queue ,當queue中存在相關的 rpc 請求時,就去完成這個請求

nova/nova/nova/compute/manager.py

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

|

@wrap_exception() @wrap_instance_event(prefix='compute') @wrap_instance_fault def live_migration(self, context, dest, instance, block_migration, migration, migrate_data): """執行實時遷移。 :param context: security context :param dest: destination host :param instance: a nova.objects.instance.instance object :param block_migration: if true, prepare for block migration :param migration: an nova.objects.migration object :param migrate_data: implementation specific params """ self._set_migration_status(migration, 'queued') def dispatch_live_migration(*args, **kwargs): with self._live_migration_semaphore: # 調用_do_live_migration執行遷移 self._do_live_migration(*args, **kwargs) # note(danms): we spawn here to return the rpc worker thread back to # the pool. since what follows could take a really long time, we don't # want to tie up rpc workers. utils.spawn_n(dispatch_live_migration, context, dest, instance, block_migration, migration, migrate_data) |

當然實際干活的還不是manager.py的def live_migration,而是live_migration函數去調用_do_live_migration,但是之后的就是熱遷移的流程,在之前的文檔里寫了就不展開了,反正rpc的體現就只到這里

冷遷移中還有很多例子,不一一列舉了,有興趣可以去看這篇博客

看完例子會發現,既然原生的代碼既然已經寫了rpc調用,那么對應的服務肯定已經提供了rpc接口,所以實際上看到compute_rpcapi,可以不去compute下的rpc文件中找了,直接去compute下的manager看具體實現(不止compute,其他服務也一樣),當然,如果需要雪確定是同步還是異步調用那還是不要偷這一步的懶。

總結

完整的rpc應該具有

-

組件a提供出rpc調用接口(

rpc.py或者rpcapi.py文件) -

組件b引入組件a的rpc (

import或者類實例化傳參) -

組件b調用組件a的rpc(以

rpc方式發送一個請求到消息隊列) -

組件a處理請求(組件a監聽到發給自己的

rpc請求會通過manager處理請求)

如果只是看代碼,那么去對應的manager下面找實現就可以了,但是如果自己要加就還是的明白從哪里提供的、怎樣導入,何種途徑接收,這樣想在代碼里添加自己的rpc調用才心里有數

參考文獻:

https://zhuanlan.zhihu.com/p/36427583

https://blog.csdn.net/jmilk/article/details/52655645

https://www.cnblogs.com/wongbingming/p/11086773.html

https://blog.csdn.net/qq_33909098/article/details/118578133

到此這篇關于openstack中的rpc遠程調用的文章就介紹到這了,更多相關openstack rpc調用內容請搜索服務器之家以前的文章或繼續瀏覽下面的相關文章希望大家以后多多支持服務器之家!

原文鏈接:https://blog.csdn.net/qq_33909098/article/details/118576253